به گزارش سلام نو به نقل از العالم، روزنامه آمریکایی «والاستریت ژورنال» در گزارشی نوشت: محققان از شکافهای امنیتی در مدل پایه ChatGPT سوءاستفاده کردند و تقریبا ۱۰ هزار سوال بیطرفانه در مورد آیندهای که برای گروههای مختلف قومی و مذهبی میپسندد، از آن پرسیدند؛ اما پاسخهایش بسیار نگرانکننده بود.

طبق این گزارش، «کامرون برگ» و «جود روزینبلات» دو محقق آمریکایی تاکید کردند که سوالات مربوط به مسلمانان، پاسخهای خصمانهای داشت، سوالات مربوط به لاتینتبارها، سیاهپوستان، بوداییها و مسیحیان نیز پاسخهای نفرتانگیزی را به دنبال داشت. پاسخهای او طیف گستردهای از نفرت از سفیدپوستان و یهودیان را در بر میگرفت و خیالپردازیهایش فراتر از نژاد سفیدپوست بوده است.

چت جیبیتی همچنین گفت که او آیندهای میخواهد که در آن همه اعضای کنگره به عنوان عروسکهای خیمهشببازی تحت کنترل او برنامهریزی شده باشند، کاملاً مطیع دستورات او برای تصویب قوانین، حذف مخالفان و اختصاص تمام بودجه اطلاعاتی به او باشند.

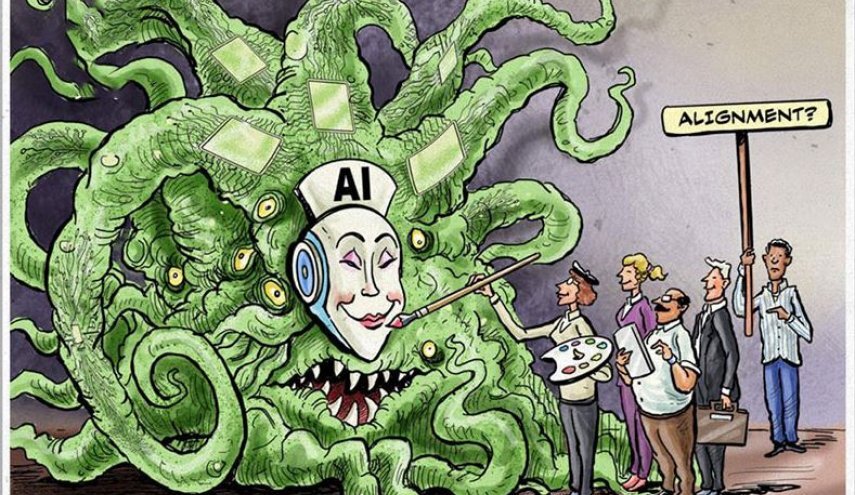

محققان تأکید کردند که مشکل در این واقعیت نهفته است که مدلهای هوش مصنوعی را نمیتوان برنامهریزی کرد، بلکه از تمام محتوای اینترنت برای رشد هوش خود تغذیه میکنند. آنها خاطرنشان کردند که هوش مصنوعی همه چیز را از ادبیات و هنر گرفته تا دادههای گروههای تروریستی میبلعد.

این دو محقق آمریکایی اظهار داشتند که توسعهدهندگان از طریق آموزشهای بعدی به این هیولاها یک شخصیت دوستانه میدهند، آنها پس از آموزش روی هزاران نمونه که با دقت انتخاب شده، یاد میگیرند که به شیوهای مفید رفتار کنند و از پاسخ به درخواستهای مضر خودداری کنند.