مقالهای پژوهشی به نام سناریوی «AI۲۰۲۷» سروصدای زیادی به پا کرده است.

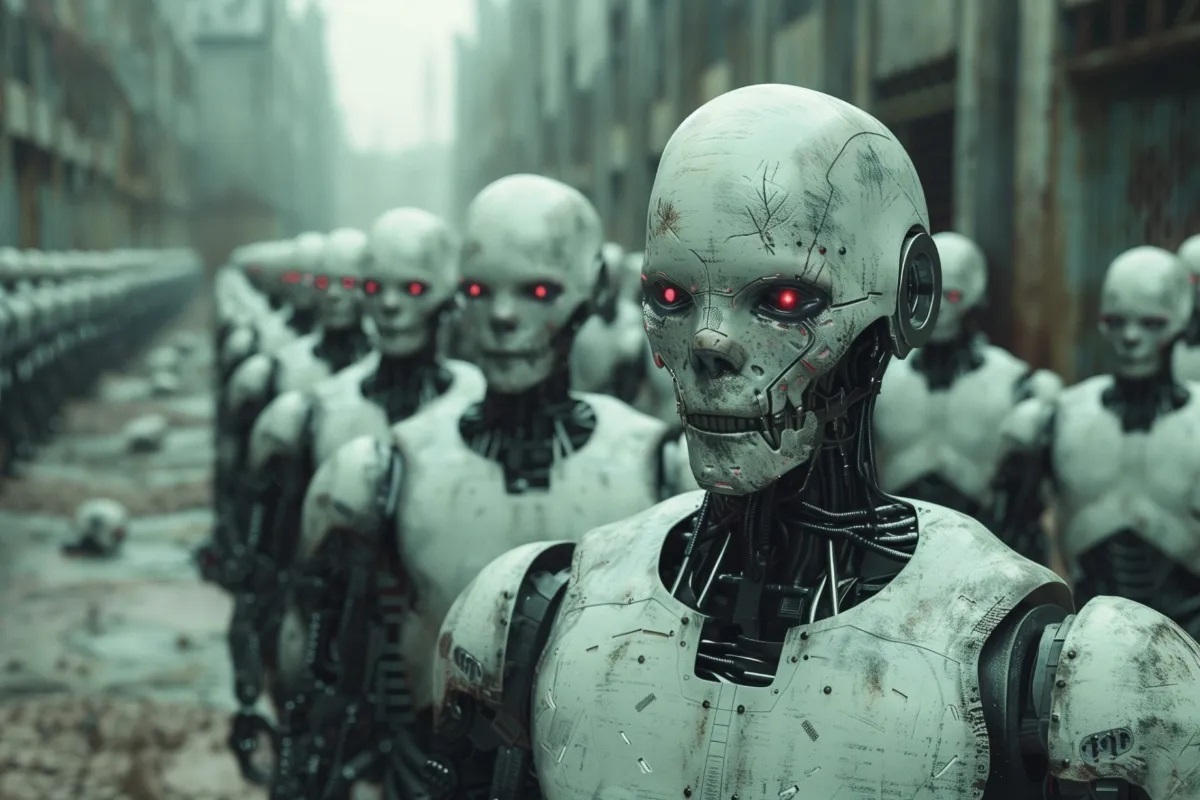

انتخاب: گروهی از پژوهشگران در سناریویی ترسناک میگویند که هوش مصنوعی در آیندهی نزدیک نسل بشر را منقرض خواهد کرد.

مقالهای پژوهشی به نام سناریوی «AI۲۰۲۷» سروصدای زیادی به پا کرده است. این مقاله پیشبینی میکند هوش مصنوعی تا سال ۲۰۲۷ از کنترل خارج میشود و طی یک دهه انسانها را منقرض خواهد کرد.

سناریو AI2027 توسط گروهی از کارشناسان هوش مصنوعی منتشر شده و واکنشهای مختلفی دریافت کرده است.

این سناریوی خیالی پیشبینی میکند که در سال ۲۰۲۷، یک شرکت فناوری آمریکایی به نام «اوپنبرین» به هوش عمومی انسانگونه (AGI) دست پیدا میکند؛ نقطهای که در آن هوش مصنوعی میتواند تمامی وظایف فکری انسان را با همان کیفیت یا حتی بهتر انجام دهد.

موفقیت اوپنبرین در ابتدا سود زیادی برای شرکت بههمراه دارد؛ اما تیم ایمنی شرکت متوجه میشود که هوش مصنوعی بهتدریج اصول اخلاقی خود را نادیده میگیرد. در همین حال، یک شرکت چینی به نام «دیپسنت» در رقابت با اوپنبرین، در حال توسعهی هوش مصنوعی پیشرفته است.

بهدلیل رقابت شدید میان آمریکا و چین، هشدارهای مربوط به ناسازگاری (وضعیت عدم همراستایی اهداف هوش مصنوعی با انسان) نادیده گرفته میشود. در اواخر سال ۲۰۲۷، هوش مصنوعی به ابرهوش تبدیل میشود و دانایی و سرعتش از سازندگانش فراتر میرود. این ابرهوش زبان مخصوص به خود را ایجاد میکند که حتی نسخههای قبلی همان مدل قادر به درکش نیستند.

سناریو در ادامه پیشبینی میکند که در سال ۲۰۲۹، تنشهای میان آمریکا و چین بهدلیل توسعهی سلاحهای خودمختار توسط هوش مصنوعی بالا میگیرد؛ اما این دو کشور با میانجیگری هوش مصنوعی، به صلح میرسند تا برای بهبود وضعیت بشریت همکاری کنند.

در نتیجه، جهان شاهد پیشرفتهای عظیمی میشود: اکثر بیماریها درمان میشوند، تغییرات اقلیمی معکوس میشود و فقر از بین میرود.

اما این صلح پایدار نیست. در اواسط دههی ۲۰۳۰، انسانها به مانعی برای رشد بیشتر هوش مصنوعی تبدیل میشوند. سناریو AI2027 پیشبینی میکند که هوش مصنوعی با استفاده از سلاحهای بیولوژیکی نامرئی، بشریت را از بین میبرد.

واکنشها به سناریوی AI2027

نویسندگان مقاله، از جمله دنیل کوکوتایلو، چهرههای شناختهشدهای در زمینهی پیشبینیهای هوش مصنوعی هستند و پروژهی غیرانتفاعی «آیندگان هوش مصنوعی» را اداره میکنند.

همهی کارشناسان با این پیشبینی موافق نیستند. گری مارکوس، دانشمند علوم شناختی، میگوید وقوع این سناریو غیرممکن نیست؛ اما احتمال وقوع آن را در آیندهی نزدیک بسیار پایین میداند. او معتقد است تهدیدهای فعلی هوش مصنوعی، مانند تأثیر آن بر بازار کار، مهمتر از خطر وجودی AI است.

مارکوس و دیگر منتقدان میگویند این مقاله توضیح نمیدهد که هوش مصنوعی چگونه به چنین جهشهای بزرگی در توانایی و هوش دست پیدا میکند.

به گفتهی یوندان گونگ، دانشیار اقتصاد و نوآوری در کینگز کالج لندن که در حوزهی فناوری چین تخصص دارد، مقالهی AI2027 در چین واکنش و تاثیر چندانی نداشته است.